Glossário de 50+ Termos Essenciais de Machine Learning

- Treinamento e Otimização de Modelos

- Regularização e Generalização

- Arquiteturas de Modelo e Componentes

- Manejo e Aumento de Dados

- Avaliação, Interpretabilidade e Explicabilidade

- Aprendizado Contínuo e ao Longo da Vida

- Funções de Perda e Métricas de Distância

- Conceitos Avançados e Teoria

- Implantação & Produção

- Métodos Probabilísticos & Generativos

- Conclusão

Se liga, machine learning é uma das áreas que mais cresce no mundo da tecnologia, e até mesmo os profissionais mais experientes podem tropeçar em termos e jargões novos. Com tantas pesquisas e novas técnicas surgindo a toda hora, seja arquitetura, funções de perda ou métodos de otimização, é fácil se perder no meio de tantos termos técnicos.

Este artigo é o seu guia prático para mais de cinquenta termos de machine learning que são muito importantes, mas que nem sempre são bem definidos. Vamos desde conceitos básicos como overfitting até ideias inovadoras como LoRA, Contrastive Loss e One Cycle Policy, com explicações claras e exemplos que vão ajudar você a entender tudo isso.

Então, mergulhe nessa leitura e se surpreenda com quantos desses termos de machine learning você ainda não conhecia!

Treinamento e Otimização de Modelos

Aqui estão termos essenciais que melhoram a eficiência, estabilidade e convergência do modelo durante o treinamento.

Curriculum Learning

Uma abordagem de treinamento onde exemplos mais complexos são apresentados ao modelo após ser exposto a exemplos mais simples. Isso pode melhorar a convergência e a generalização ao imitar o aprendizado humano.

Exemplo: Primeiro, um classificador de dígitos é treinado com imagens claras e de alto contraste antes de introduzir imagens ruidosas e de baixa qualidade.

É como ensinar uma criança a ler, começando por palavras simples antes de evoluir para sentenças mais complicadas, evitando que o modelo desanime com problemas difíceis logo de cara.

One Cycle Policy

Uma técnica de ajuste de taxa de aprendizado que impulsiona a eficiência do treinamento, começando com uma taxa pequena, aumentando para um pico e depois diminuindo novamente.

Exemplo: A taxa de aprendizado varia de 0.001 a 0.01, voltando a 0.001 ao longo dos períodos de treinamento.

Pense nisso como um “aquecimento, sprint e resfriamento” para o modelo. Inicialmente baixa, a taxa permite ao modelo se situar, aumentando para evitar regiões subótimas e, por fim, afinando os pesos para ajustes finais.

Lookahead Optimizer

Um método que suaviza o caminho da otimização ao envolver outros otimizadores, mantendo pesos de movimentos lentos atualizados pela direção dos otimizadores rápidos.

Exemplo: Lookahead combinado com Adam resulta em convergência mais rápida e estável.

Imagine um “exército principal” (pesos lentos) seguindo a direção encontrada por um “batedor rápido” (otimizador interno). A estratégia acelera a convergência do modelo com menos variação.

Sharpness Aware Minimization (SAM)

Um método de otimização que leva modelos a convergirem em mínimos mais planos, considerados melhores para dados não vistos.

Exemplo: Resultam em modelos robustos para dados de teste e treinamento.

Pense em manter uma bola equilibrada num vale. Um vale amplo, “mínimo plano”, é muito mais estável que um vale estreito e profundo, “mínimo acentuado”. O SAM busca os vales amplos, tornando modelos mais resistentes a ajustes de entrada.

Gradient Clipping

Previne explosões de gradiente, limitando-os a um valor específico. Isso garante um treinamento estável, especialmente em redes recorrentes.

Exemplo: Gradientes de RNN são clipados para evitar divergência durante o treinamento.

Como limitar o volume de um grito, esta técnica impede que o modelo atualize seus pesos de maneira exagerada, o que poderia destruir o processo de treinamento.

Bayesian Optimization

Uma técnica para otimizar funções que são custosas de avaliar (como ajuste de hiperparâmetros), direcionando a busca com modelos probabilísticos.

Exemplo: Usar menos execuções de treinamento para encontrar a melhor taxa de aprendizado eficientemente.

Em vez de tentar a sorte em várias combinações, a otimização bayesiana utiliza um “mapa” probabilístico para decidir a próxima área de busca, focando em promissores e evitando desperdícios com configurações que provavelmente não são eficazes.

Batch Renormalization

Uma variação da normalização em lote que corrige diferenças entre estatísticas de lote e globais, tornando-a mais estável com pequenos tamanhos de lote.

Exemplo: Ajuda a treinar modelos quando o tamanho do lote é limitado a 4 pela memória da GPU.

Um “óculos corretivo” para normalização em lote que compensa o pequeno alcance, ajustando estatísticas do lote para se parecerem mais com o dataset completo.

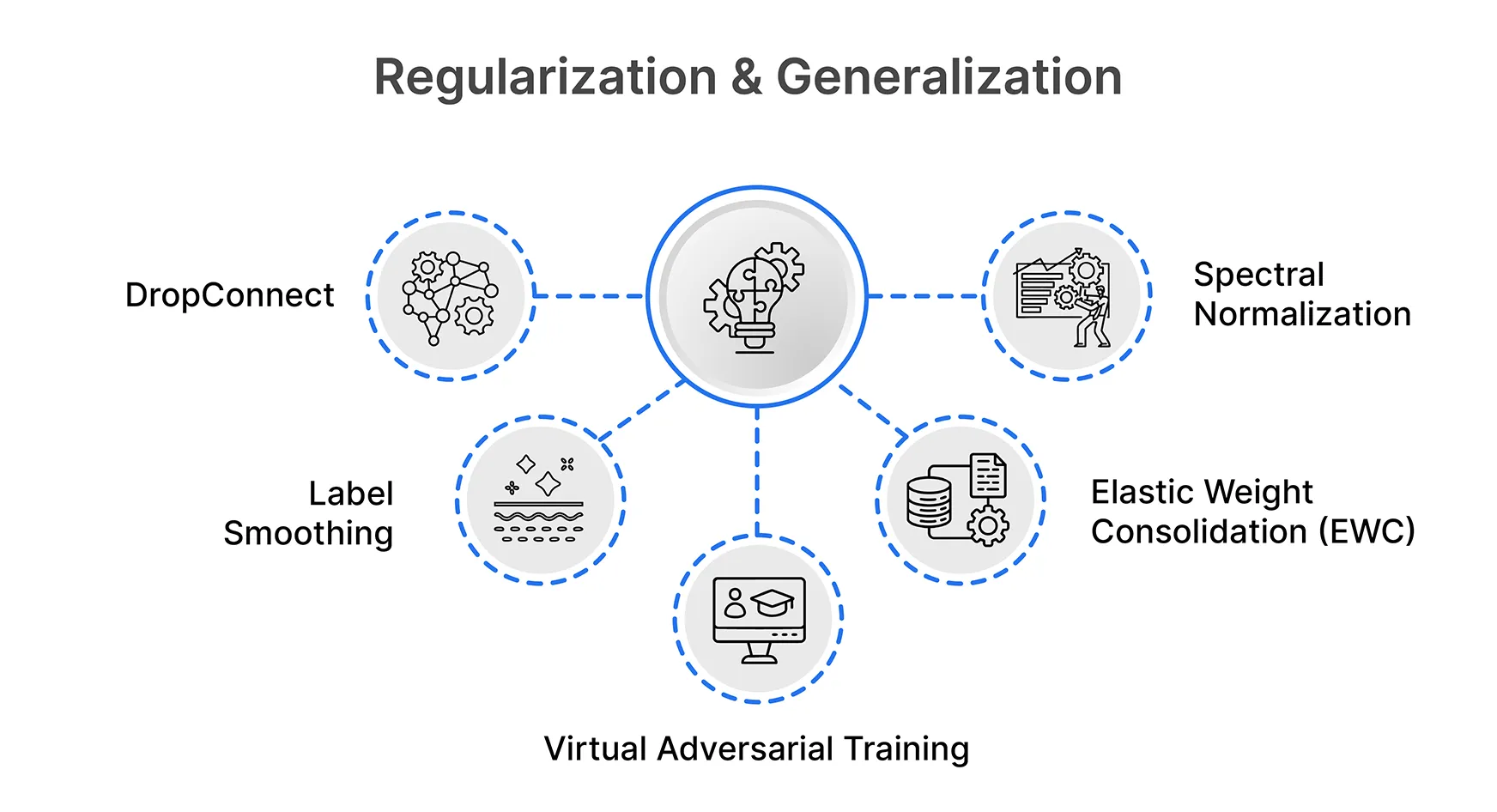

Regularização e Generalização

Esses termos ajudam modelos a melhor generalizar dados não vistos enquanto evitam o overfitting e a memorização.

DropConnect

Em vez de desativar neurônios inteiros durante o treinamento, como no Dropout, essa técnica desativa aleatoriamente pesos ou conexões entre neurônios.

Exemplo: Uma conexão entre dois neurônios é desativada, introduzindo robustez.

Semelhante a cortar linhas telefônicas individuais numa rede social, forçando a rede a criar caminhos alternativos, mantendo-se robusta mesmo com menos conexões.

Label Smoothing

Uma técnica que suaviza rótulos durante o treinamento para evitar que o modelo se torne excessivamente confiante, compartilhando um pouco da massa de probabilidade com as classes erradas.

Exemplo: Classe A é rotulada como 0.9 em vez de 1.0, e as outras, como 0.1.

O modelo aprende a não ser completamente certo, melhorando sua adaptabilidade para exemplos novos, evitando previsões excessivamente otimistas.

Virtual Adversarial Training

Adiciona pequenas mudanças aos inputs durante o treinamento para regular previsões, aumentando a robustez do modelo.

Exemplo: Adicionar ruído sútil às imagens melhora a estabilidade da classificação.

Como um parceiro de sparring que vai aprimorando suas fraquezas, tornando o modelo mais confiável e menos suscetível a dados reais ruidosos.

Elastic Weight Consolidation (EWC)

Uma técnica de regularização que penaliza alterações excessivas em pesos cruciais para manter conhecimento de tarefas anteriores.

Exemplo: Você aprende novas tarefas sem esquecer as antigas.

Similar a alguém que toca guitarra e aprende piano, EWC ajuda a lembrar da “memória muscular” crucial da guitarra ao dificultar alterações nos pesos durante aprendizado do piano.

Spectral Normalization

Eleva a estabilidade do treinamento em redes neurais ao restringir a norma espectral das matrizes de peso.

Exemplo: Restrições de Lipschitz são aplicadas em discriminadores GAN para um treinamento adversarial mais estável.

Pense nisso como limitar quão rápido o modelo pode mudar de comportamento, regulando o “amplificação máxima” que cada camada pode aplicar, evitando caos ou instabilidade.

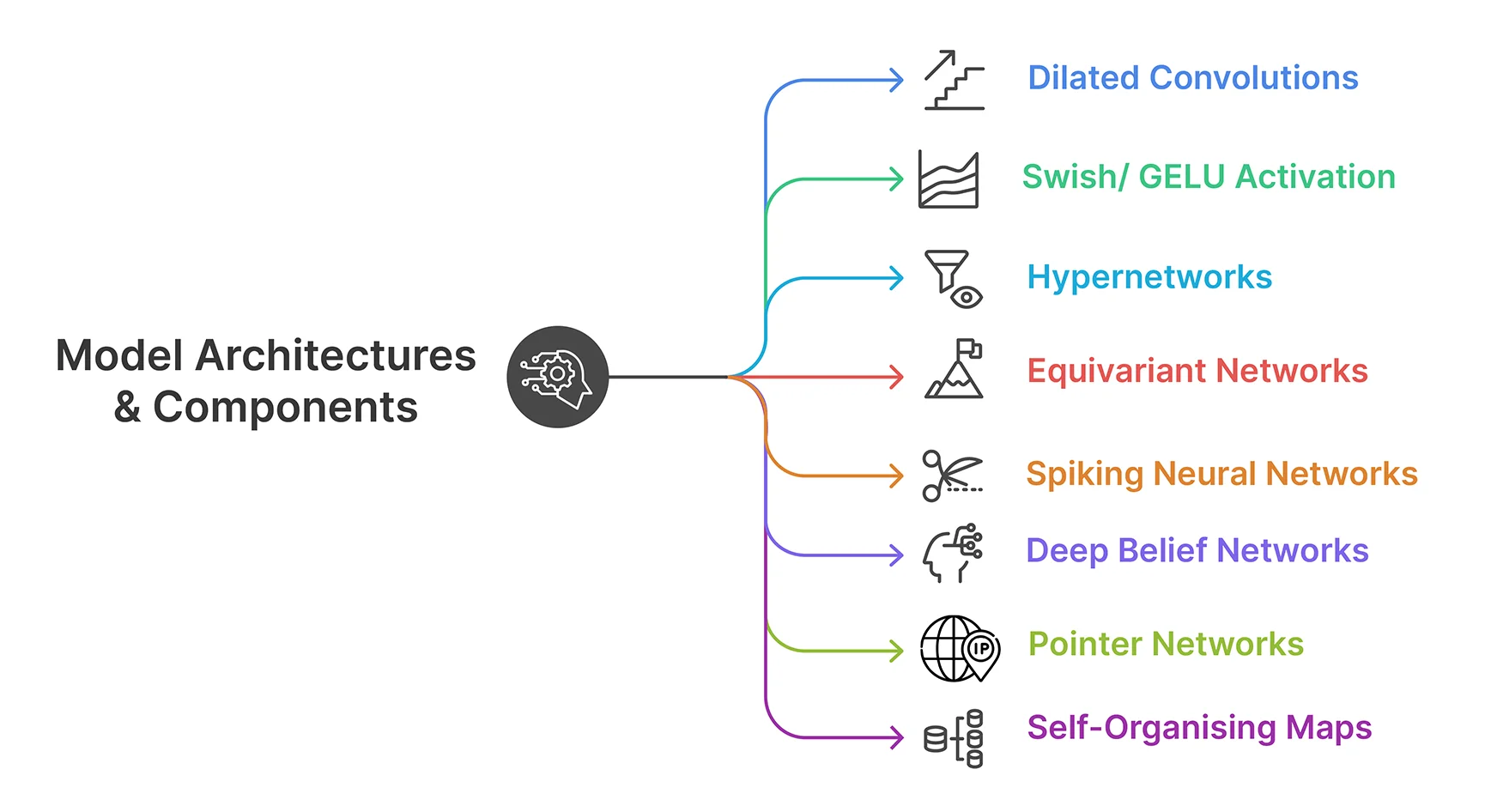

Arquiteturas de Modelo e Componentes

Esta seção traz termos avançados relacionados à estruturação das redes neurais e como processam informações.

Dilated Convolutions

Essas operações de convolução criam espaços entre elementos do kernel, permitindo que redes tenham um campo receptivo mais amplo sem adicionar mais parâmetros.

Exemplo: WaveNet é usado em geração de áudio para registrar dependências de longo alcance.

Como dar passos maiores para entender rapidamente o quadro geral, capturando mais contexto com o mesmo custo computacional.

Swish/ GELU Activation

Mais suaves e diferenciáveis que ReLU, estas avançadas funções de ativação melhoram a convergência e performance em modelos mais profundos.

Exemplo: EfficientNet usa Swish para maior precisão, enquanto BERT utiliza GELU.

Swish e GELU são como dimmers de luzes, permitindo um fluxo de gradiente mais estável durante a retropropagação, facilitando o processamento de informações para melhor precisão final.

HyperNetworks

Arquiteturas dinâmicas e condicionais são possibilitadas por redes neurais que produzem os pesos de outras redes neurais.

Exemplo: MetaNet cria pesos de camada de forma dinâmica para várias tarefas.

Como uma “rede mestra” fabricando pesos para uma “rede operária” distinta, permitindo a rápida criação de modelos personalizados.

Equivariant Networks

Redes preditivas que preservam propriedades de simetria (como translação ou rotação) são úteis em campos científicos.

Exemplo: CNNs rotacionalmente equivariante são usadas em imagem médica e reconhecimento de objetos 3D.

Essas redes incorporam simetrias fundamentais, como a física, permitindo previsões altamente precisas e eficientes em dados científicos.

Spiking Neural Networks

Ao invés de utilizar valores contínuos, este tipo de rede neural transmite informações usando eventos discretos (picos), parecidos com neurônios biológicos.

Exemplo: Utilizado em hardware economico de energia para aplicações de processamento sensorial em tempo real.

Deep Belief Networks

Uma classe de rede neural profunda composta de múltiplas camadas de variáveis latentes, com conexões entre as camadas, mas não entre as unidades dentro de cada camada.

Exemplo: Redes neurais profundas são pré-treinadas usando esse método.

Pense em uma pilha de panquecas, cada uma representando um grau de abstração dos dados.

Pointer Networks

Um tipo específico de rede neural treinada para identificar um elemento específico de uma sequência.

Exemplo: Aplicado para resolver problemas como o problema do caixeiro-viajante.

Como se ter um GPS que sempre aponta a próxima curva em cada interseção.

Self-Organising Maps

Uma espécie de rede neural não supervisionada que cria uma representação discretizada e de baixa dimensão do espaço de entrada.

Exemplo: Usado para exibir dados de alta dimensão de uma forma que torna sua estrutura subjacente visível.

É como montar um mosaico com azulejos, onde cada azulejo representa um aspecto distinto da imagem original.

Manejo e Aumento de Dados

Aprenda termos focados em preparar, gerenciar e enriquecer dados de treinamento para aumentar a performance do modelo.

Mixup Training

Uma abordagem de aumento de dados que suaviza as fronteiras de decisão e reduz o overfitting ao interpolar duas imagens e seus rótulos para produzir amostras de treinamento sintéticas.

Exemplo: Uma imagem nova com rótulo refletindo a mistura é feita de 70% cachorro e 30% gato.

O modelo aprende que nem sempre as coisas são preto no branco, permitindo transições mais suaves entre categorias e melhor generalização.

Feature Store

Um sistema centralizado para gerenciamento de equipes e projetos, serving de características de ML e reutilização.

Exemplo: Salvar e reutilizar “faixa etária de usuário” em vários modelos.

Pense nisso como uma despensa de qualidade para cientistas de dados, onde características pre-processadas e documentadas podem ser puxadas diretamente para garantir consistência e minimizar erros.

Batch Effect

Diferenças técnicas sistemáticas que podem confundir resultados de análise entre lotes de dados.

Exemplo: Dados de expressão genética processados em dias diferentes mostram variações consistentes não relacionadas à biologia.

É como se diferentes câmeras fossem usadas para tirar fotos da mesma cena, gerando variações técnicas sistemáticas que precisam de correção.

Avaliação, Interpretabilidade e Explicabilidade

Estes termos ajudam a quantificar a precisão do modelo e fornecem insights sobre o porquê das previsões feitas.

Cohen’s Kappa

Uma métrica estatística que considera a possibilidade de dois classificadores ou avaliadores concordarem por acaso.

Exemplo: Kappa considera o acordo aleatório e pode ser menor mesmo quando dois médicos concordam 85% das vezes.

Ela avalia o “acordo verdadeiro” além do que se esperaria por acaso, respondendo “quão sincronizados realmente estão os avaliadores, além do acaso?”.

Brier Score

Calcula a média das diferenças quadradas entre probabilidades esperadas e resultados reais para avaliar quão precisas são as previsões probabilísticas.

Exemplo: Um modelo com maiores probabilidades calibradas terá uma pontuação menor na escala Brier.

Essa pontuação avalia a confiabilidade a longo prazo de um previsor, incentivando a veracidade e precisão em cálculos de probabilidade.

Counterfactual Explanations

Explicam como uma outra previsão do modelo poderia resultar se alterássemos os dados de entrada.

Exemplo: O empréstimo de um usuário seria concedido se sua renda fosse R$50.000 em vez de R$30.000.

Essa abordagem torna a lógica do modelo clara e tangível, respondendo à pergunta “e se” com alternativas reais e possíveis.

Ancoras

Regras de alta precisão e simplicidade que, em alguns cenários, garantem uma previsão.

Exemplo: “Aprovar sempre um empréstimo se o tomador tiver mais de 60 anos e uma renda superior a R$80.000.”.

Oferecem uma explicação precisa e altamente confiável para certas previsões, mesmo que a atuação geral do modelo seja complexa.

Integrated Gradients

Uma técnica de atribuição que integra gradientes ao longo do caminho de entrada para determinar a contribuição correspondente de cada característica de entrada para uma previsão.

Exemplo: Indica quais pixels tiveram o maior impacto na classificação de uma imagem.

Fornece um “mapa de calor” de importância relativa dos recursos de entrada, revelando palavras ou pixels que mais afetaram uma decisão.

Detecção Fora de Distribuição

Encontrar entradas que diferem dos dados usados para treinar um modelo.

Exemplo: O sistema de câmeras de um carro autônomo deve reconhecer quando vê um novo tipo de objeto.

Semelhante a um inspetor revisando produtos numa linha de montagem, procurando por objetos inesperados.

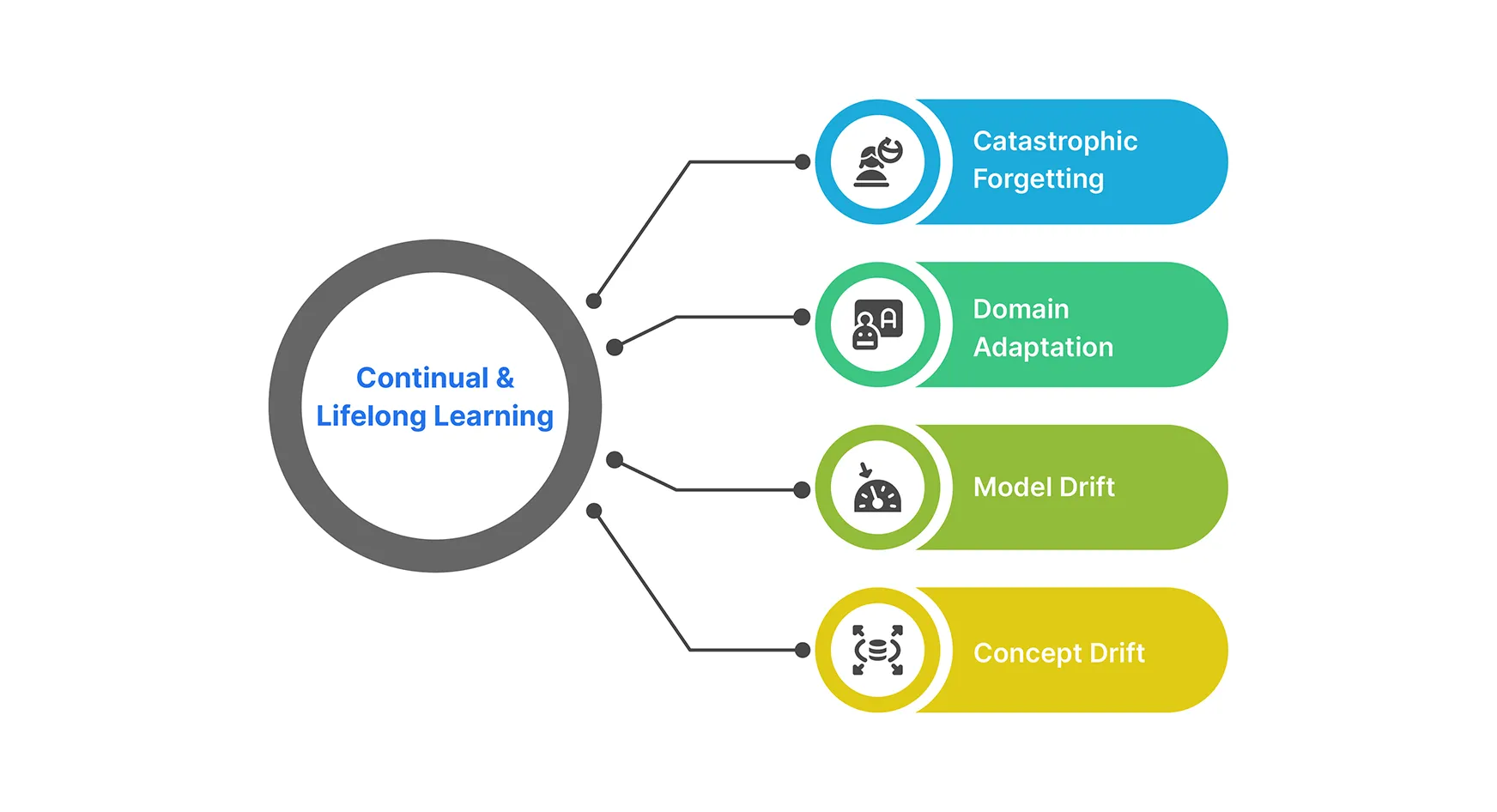

Aprendizado Contínuo e ao Longo da Vida

Essa parte explica termos relevantes para modelos que se adaptam sem esquecer tarefas já aprendidas.

Esquecimento Catastrófico

Quando um modelo treinado para novas tarefas esquece o que já aprendeu. Um obstáculo significativo para o aprendizado contínuo.

Exemplo: Um modelo treinado para reconhecer animais esquece tudo ao ser retraîner para veículos.

Isso acontece porque o modelo substitui os pesos importantes das informações antigas por novos requerimentos da tarefa atual, semelhante a esquecer línguas antigas.

Adaptação de Domínio

O desafio de adaptar um modelo treinado numa distribuição de dados-fonte para uma outra, mas relacionada, distribuição de dados-alvo.

Exemplo: Pode ser necessário ajustar um filtro de spam treinado num e-mail de uma organização para funcionar corretamente em outra.

Pense em um tradutor que domina um dialeto de uma língua, mas precisa aprender outro.

Desvio de Modelo

Quando o desempenho do modelo piora ao longo do tempo devido a mudanças nas distribuições de dados de entrada.

Exemplo: Modelos recomendadores de e-commerce são impactados por mudanças de comportamento dos consumidores após a pandemia do COVID-19.

Pense nisso como navegar com um mapa desatualizado. Desde que fornece seu uso em mudanças atuais.

Deriva de Conceito

Ocorre quando as características do alvo de uma variável, que o modelo está tentando prever, mudam inesperadamente.

Exemplo: Um modelo de previsão de churn pode perder precisão conforme o comportamento do cliente evolui.

Isso é semelhante a usar um mapa de cidade antigo que já não é mais preciso.

Funções de Perda e Métricas de Distância

Esses termos definem como as previsões do modelo são avaliadas e comparadas aos resultados reais.

Aprendizado Contrastivo

Empurra os dados desiguais para longe e aproxima representações de dados semelhantes no espaço latente.

Exemplo: SimCLR compara pares de imagens aumentadas para aprender representações, e CLIP usa essa lógica.

Um jogo de “ache as diferenças” no mundo da IA, aprendendo a diferenciar nuances ao encontrar semelhanças.

Triplet Loss

Funciona como uma função de perda para treinar modelos a aproximar entradas semelhantes e afastar as dissimilares no espaço aprendido.

Exemplo: Em sistemas de reconhecimento facial, o modelo é treinado para minimizar a distância entre imagens do mesmo rosto e maximizar entre rostos diferentes.

Se mudar um autor, triplet loss arruma os livros no mesmo estante, algo como re-organizar sua biblioteca.

Distância Wasserstein

Fornece medidas de distância mais significativas que a divergência de KL, calculando o “custo” de alterar uma distribuição de probabilidade para outra.

Exemplo: GANs Wasserstein usa para garantir maior estabilidade nos gradientes de treinamento.

Imagine mover montes de areia até que combinem uma forma semelhante. Considerando o “custo de transporte”, enquanto outras medidas de distância não.

Conceitos Avançados e Teoria

Esses são termos que sustentam pesquisas de ponta e avanços teóricos em machine learning.

Hipótese da Loteria

Propõe que há uma sub-rede menor, adequadamente inicializada, dentro de uma rede neural grande, que pode ser treinada separadamente para obter o mesmo desempenho.

Exemplo: Alta precisão é alcançada ao treinar uma pequena parte de um ResNet50 “podado” do zero.

Como uma loteria enorme, essa hipótese sugere um pequeno sub-rede “bilhete premiado” escondido desde o início.

Meta Aprendizado

Envolve ensinar um modelo a se ajustar rapidamente a novas tarefas com poucos dados.

Exemplo: O MAML permite adaptação rápida a novas tarefas de reconhecimento de imagem.

Ensina o modelo o processo geral de aprendizado, como fazer um aluno mestre em novas disciplinas com poucos estudos.

Neural Tangent Kernel

Um estrutura teórica que oferece insights sobre generalização ao examinar a dinâmica de aprendizado de redes neurais infinitamente largas.

Exemplo: Facilita a análise do comportamento de treinamento de redes profundas sem treino real.

Importante ferramenta matemática que conecta aprendizado profundo a técnicas de kernel, oferecendo declarações precisas sobre o processo de aprendizado.

Manifold Learning

Procurar uma representação de baixa dimensão de dados de alta dimensão enquanto mantém a estrutura geométrica dos dados.

Exemplo: Para entender melhor a estrutura de um conjunto de dados de alta dimensão, visualizá-lo em duas ou três dimensões.

Criar um mapa plano da Terra, representando um objeto tridimensional como dois.

Disentangled Representation

Um tipo de aprendizado de representação onde as características aprendidas se correspondem a fatores compreensíveis de variação nos dados.

Exemplo: Um modelo que aprenda a representar rostos pode ter características distintas para expressões faciais, cor dos olhos e cor do cabelo.

Como um conjunto de sliders, permitindo ajustar várias seções de uma imagem independently.

Gumbel-Softmax Trick

Uma aproximação diferenciável de uma amostragem de distribuição categórica que permite otimização baseada em gradiente usando escolhas discretas.

Exemplo: Variational Autoencoders são treinados end-to-end usando variáveis latentes categóricas em modelos de variáveis latentes discretos.

Obtém um “gradiente suave” que se pode treinar ao contrário.

Denoising Score Matching

Um método para estimar gradientes de função de densidade (função escore) por meio de treinamento de modelo para aprender distribuições de probabilidade.

Exemplo: Modelos de difusão usam matching de escore para aprender a reverter o processo de ruído e criar amostras novas.

“Empurre” cada pixel na direção certa para tornar uma imagem confusa mais clara.

Implantação & Produção

Concentra-se em termos que garantem que modelos funcionem eficientemente, de forma confiável e segura em ambientes do mundo real.

Implantação Shadow

Uma abordagem usada para testes silenciosos onde um novo modelo é implementado paralelamente ao existente sem afetar usuários finais.

Exemplo: Teste de qualidade de modelo sem risco em produção.

Simulador de vôo que recebe dados de vôo em tempo real mas suas ações não afetam a aeronave.

Latência de Serviço

Quanto tempo leva para um modelo implantado fornecer uma previsão. Em sistemas em tempo real, baixa latência é essencial.

Exemplo: Um assistente de voz precisa de uma resposta do modelo em menos de 50 ms.

Tempo entre uma pergunta ao modelo e a resposta, sendo primordial em muitas aplicações reais.

Métodos Probabilísticos & Generativos

Explore termos que lidam com modelagem de incerteza e a geração de novas amostras por meio de técnicas probabilísticas.

Inferências Variacionais

Uma técnica aproximada que usa otimização sobre distribuições em vez de amostra para realizar inferência bayesiana.

Exemplo: Um espaço latente probabilístico é aprendido em VAEs.

Para problemas de probabilidade difíceis, ajusta distribuições a uma mais fácil para viabilizar a computação através de otimização.

Monte Carlo Dropout

Um método para estimar incerteza de previsão que envolve fazer médias de previsões em várias passagens e aplicar dropout no tempo de inferência.

Exemplo: Obter estimativas de incerteza sobre a probabilidade de tumores.

A técnica transforma uma rede padrão numa probabilística, fornecendo diversos outputs para estimar incerteza.

Knowledge Distillation

Um método de compressão que ensina um “estudante” menor a imitar um “professor” maior.

Exemplo: A saída suavizada guia o aluno com probabilidades suaves de classes.

Um aprendiz é ensinado por um mestre, aprendendo a mesma lógica intrincada.

Normalizing Flows

Convertem uma distribuição simples de probabilidade em algo complexo para modelagem gerativa usando funções invertíveis.

Exemplo: Glow cria imagens incríveis através de flows normalizadors.

Pense como prismas matemáticos transformando formas simples em esculturas detalhadas, permitindo criar novos dados.

Inferência Causal

Ramo que foca em descobrir relações causais entre variáveis.

Exemplo: Entender se uma campanha de marketing realmente aumentou as vendas ou foi mera coincidência.

Entender a lógica profunda por trás de ações e reações, como diferenciar causas de corvos.

Dynamic Time Warping

Um algoritmo para alinhar melhor sequências temporais que podem variar em tempo ou velocidade para medir similaridade.

Exemplo: Comparar dois sinais de fala em velocidades diferentes ou alinhar séries de tempo financeiras com tendências sazonais variadas.

Como alinhar notas de duas músicas em tempos diferentes.

Conclusão

Compreender estes 50+ termos de machine learning não é só sobre aprender definições, mas desenvolver um entendimento de como os sistemas de ML modernos são desenvolvidos, treinados, otimizados e implementados.

Esses conceitos destacam a complexidade e beleza dos sistemas que utilizamos diariamente. Quer você esteja lendo um artigo de pesquisa, desenvolvendo seu próximo modelo ou solucionando resultados inesperados, deixe este glossário servir como um mapa mental para navegar o campo em constante mudança.

Fonte: Analytics Vidhya