GenAI Processors: A Solução para Aplicações de IA em Tempo Real

Imagine um aplicativo de inteligência artificial que processa sua voz, analisa o feed da câmera e se engaja em conversas humanas em tempo real. Até pouco tempo, criar uma aplicação multimodal tão intensiva em tecnologia exigia que os engenheiros lidassem com as complexidades de operações assíncronas, gerindo várias chamadas de API e juntando códigos que depois se revelavam difíceis de manter ou depurar. Mas isso está mudando graças aos GenAI Processors.

Essa biblioteca revolucionária de código aberto em Python, desenvolvida pelo Google DeepMind, abriu novas possibilidades para desenvolvedores interessados em aplicativos de IA. A biblioteca transforma o caótico cenário do desenvolvimento de IA em um ambiente sereno para os desenvolvedores. Neste artigo, vamos explorar como os GenAI Processors tornam os complexos fluxos de trabalho de IA mais acessíveis, ajudando-nos assim a construir um agente de IA ao vivo.

O Que São os GenAI Processors?

GenAI Processors é uma nova biblioteca de código aberto em Python desenvolvida pela DeepMind para trazer estrutura e simplicidade aos desafios do desenvolvimento de IA. Eles atuam como uma abstração que define uma interface comum para o tratamento de entrada, pré-processamento, chamadas reais de modelos e processamento de saída.

Os GenAI Processors funcionam como uma linguagem comum entre os fluxos de trabalho de IA. Em vez de escrever códigos personalizados do zero para cada componente da sua pipeline de IA, você simplesmente trabalha com unidades padronizadas de “Processador” que são fáceis de combinar, testar e manter. No seu núcleo, veem toda entrada e saída como um fluxo assíncrono de ProcessorParts, partes de dados padronizados fluindo através da pipeline (por exemplo, pedaços de áudio, transcrições de texto, quadros de imagem) acompanhadas de metadados.

Os conceitos principais aqui nos GenAI Processors são:

- Processors: Unidades individuais de trabalho que recebem fluxos de entrada e produzem fluxos de saída.

- Processor Parts: Pedaços de dados padronizados com metadados.

- Streaming: Fluxo de dados bidirecional em tempo real através da sua pipeline.

- Composição: Combinar processadores usando operações simples.

Principais Características dos GenAI Processors

- Composição de ponta a ponta: Isso é feito juntando operações com uma sintaxe intuitiva. Exemplo:

live_agent = input_processor + live_processor + play_output - Projeto Assíncrono: Desenvolvido com o asyncio do Python para lidar eficientemente com tarefas dependentes de I/O e computações puras com encadeamento manual.

- Suporte Multimodal: Manipula texto, áudio, vídeo e imagem em uma única interface unificada.

- Streaming Bidirecional: Permite comunicação em tempo real entre componentes.

- Arquitetura Modular: Componentes reutilizáveis e testáveis que facilitam a manutenção.

- Integração com Gemini: Suporte nativo para a API do Gemini Live e operações comuns de LLM baseadas em texto.

Como Instalar os GenAI Processors?

Pré-requisitos

- Python 3.8+

- Gerenciador de pacotes Pip

- Conta no Google Cloud (para acesso à API Gemini)

Passos para Instalação

- Instale a biblioteca:

pip install genai-processors - Configuração para autenticação:

Para Google AI Studio:export GOOGLE_API_KEY="your-api-key"

Ou para Google Cloud:gcloud auth application-default login - Verificando a Instalação:

import genai_processorsprint(genai_processors.__version__) - Configuração de Desenvolvimento (opcional):

git clone https://github.com/google-gemini/genai-processors.gitcd genai-processorspip install -e

Como Funcionam os GenAI Processors?

Os GenAI Processors funcionam através de um modo de processamento baseado em fluxo, onde os dados fluem ao longo de uma pipeline de processadores conectados. Cada processador:

- Recebe um fluxo de Processor Parts

- Processa os dados (transformações, chamadas de API, etc.)

- Emite um fluxo de resultados

- Passa os resultados para o próximo processador na cadeia

Exemplo de Fluxo de Dados

Entrada de Áudio → Fala para Texto → Processamento LLM → Texto para Fala → Saída de Áudio

ProcessorPart → ProcessorPart → ProcessorPart → ProcessorPart → ProcessorPart

Componentes Centrais

- Processadores de Entrada:

VideoIn(): Processamento de fluxo da câmeraPyAudioIn(): Entrada de microfoneFileInput(): Entrada de arquivo

- Processadores de Processamento:

LiveProcessor(): Integração com Gemini Live APIGenaiModel(): Processamento padrão de LLMSpeechToText(): Transcrição de áudioTextToSpeech(): Síntese de voz

- Processadores de Saída:

PyAudioOut(): Reprodução de áudioFileOutput(): Escrita de arquivoStreamOutput(): Transmissão em tempo real

Concorrência e Desempenho

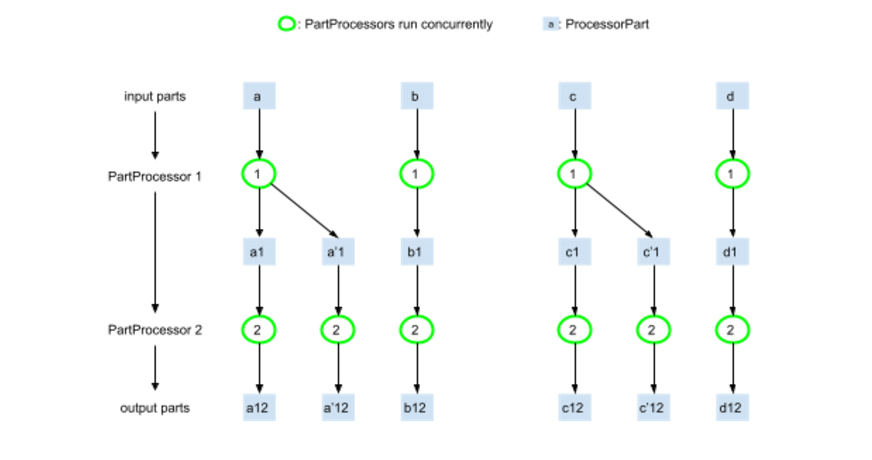

Os GenAI Processors foram projetados para maximizar a execução simultânea de um processador. Qualquer parte desse fluxo de execução pode ser executada simultaneamente sempre que todos os seus antecessores no gráfico forem computados. Em outras palavras, sua aplicação estaria essencialmente processando múltiplos fluxos de dados simultaneamente, acelerando o tempo de resposta e a experiência do usuário.

Mão na Massa: Construindo um Agente ao Vivo com GenAI Processors

Vamos construir um agente de IA ao vivo que junta fluxos de câmera e áudio, envia-os para a API Gemini Live para processamento e finalmente recebe respostas de áudio.

Quer se aprofundar mais? Confira o nosso programa completo de pioneiros em agentes de IA aqui.

Estrutura do Projeto

Veja como seria a estrutura do nosso projeto: live_agent/

├── main.py

├── config.py

└── requirements.txt

Passo 1: Etapa de Configuração

config.py

import os

from genai_processors.core import audio_io

# Configuração da API

GOOGLE_API_KEY = os.getenv("GOOGLE_API_KEY")

if not GOOGLE_API_KEY:

raise ValueError("Por favor, defina a variável de ambiente GOOGLE_API_KEY")

# Configuração de áudio

AUDIO_CONFIG = audio_io.AudioConfig(

sample_rate=16000,

channels=1,

chunk_size=1024,

format="int16"

)

# Configuração de vídeo

VIDEO_CONFIG = {

"width": 640,

"height": 480,

"fps": 30

}

Passo 2: Implementação do Agente Principal

main.py

import asyncio

from genai_processors.core import (

audio_io,

live_model,

video,

streams

)

from config import AUDIO_CONFIG, VIDEO_CONFIG, GOOGLE_API_KEY

class LiveAgent:

def __init__(self):

self.setup_processors()

def setup_processors(self):

"""Inicializa todos os processadores para o agente ao vivo"""

# Processador de entrada: combina câmera e microfone

self.input_processor = (

video.VideoIn(

device_id=0,

width=VIDEO_CONFIG["width"],

height=VIDEO_CONFIG["height"],

fps=VIDEO_CONFIG["fps"]

) +

audio_io.PyAudioIn(

config=AUDIO_CONFIG,

device_index=None # Use microfone padrão

)

)

# Processador da API Gemini Live

self.live_processor = live_model.LiveProcessor(

api_key=GOOGLE_API_KEY,

model_name="gemini-2.0-flash-exp",

system_instruction="Você é um assistente de IA útil. Responda naturalmente às interações do usuário."

)

# Processador de saída: lida com a reprodução de áudio com suporte a interrupção

self.output_processor = audio_io.PyAudioOut(

config=AUDIO_CONFIG,

device_index=None, # Use alto-falante padrão

enable_interruption=True

)

# Pipeline completa do agente

self.agent = (

self.input_processor +

self.live_processor +

self.output_processor

)

async def run(self):

"""Inicia o agente ao vivo"""

print("🤖 Agente ao Vivo iniciando...")

print("🎥 Câmera e microfone ativos")

print("🔊 Saída de áudio pronta")

print("💬 Comece a falar para interagir!")

print("Pressione Ctrl+C para parar")

try:

async for part in self.agent(streams.endless_stream()):

# Processa diferentes tipos de saída

if part.part_type == "text":

print(f"🤖 IA: {part.text}")

elif part.part_type == "audio":

print(f"🔊 Pedaço de áudio: {len(part.audio_data)} bytes")

elif part.part_type == "video":

print(f"🎥 Quadro de vídeo: {part.width}x{part.height}")

elif part.part_type == "metadata":

print(f"📊 Metadados: {part.metadata}")

except KeyboardInterrupt:

print("\n👋 Agente ao Vivo parando...")

except Exception as e:

print(f"❌ Erro: {e}")

# Agente avançado com processamento personalizado

class CustomLiveAgent(LiveAgent):

def __init__(self):

super().__init__()

self.conversation_history = []

self.user_emotions = []

def setup_processors(self):

"""Configuração aprimorada com processadores personalizados"""

from genai_processors.core import (

speech_to_text,

text_to_speech,

genai_model,

realtime

)

# Processamento de entrada personalizado com STT

self.input_processor = (

audio_io.PyAudioIn(config=AUDIO_CONFIG) +

speech_to_text.SpeechToText(

language="en-US",

interim_results=True

)

)

# Modelo personalizado com memória de conversa

self.genai_processor = genai_model.GenaiModel(

api_key=GOOGLE_API_KEY,

model_name="gemini-pro",

system_instruction="Você é um assistente de IA empático. Lembre-se de nosso histórico de conversas e responda com inteligência emocional. Se o usuário parecer chateado, seja solidário. Se estiverem animados, compartilhe seu entusiasmo."

)

# TTS personalizado com emoção

self.tts_processor = text_to_speech.TextToSpeech(

voice_name="en-US-Neural2-J",

speaking_rate=1.0,

pitch=0.0

)

# Limitação de taxa de áudio para reprodução suave

self.rate_limiter = audio_io.RateLimitAudio(

sample_rate=AUDIO_CONFIG.sample_rate

)

# Pipeline completa personalizada

self.agent = (

self.input_processor +

realtime.LiveModelProcessor(

turn_processor=self.genai_processor + self.tts_processor + self.rate_limiter

) +

audio_io.PyAudioOut(config=AUDIO_CONFIG)

)

if __name__ == "__main__":

# Escolha o tipo de agente

agent_type = input("Escolha o tipo de agente (1: Simples, 2: Personalizado): ")

if agent_type == "2":

agent = CustomLiveAgent()

else:

agent = LiveAgent()

# Execute o agente

asyncio.run(agent.run())

Passo 3: Recursos Aprimorados

Vamos adicionar detecção de emoção e personalização de resposta.

class EmotionAwareLiveAgent(LiveAgent):

def __init__(self):

super().__init__()

self.emotion_history = []

async def process_with_emotion(self, text_input):

"""Processar entrada com consciência emocional"""

# Detecção de emoção simples (na prática, use métodos mais sofisticados)

emotions = {

"happy": ["great", "awesome", "fantastic", "wonderful"],

"sad": ["sad", "disappointed", "down", "upset"],

"excited": ["amazing", "incredible", "wow", "fantastic"],

"confused": ["confused", "don't understand", "what", "how"]

}

detected_emotion = "neutral"

for emotion, keywords in emotions.items():

if any(keyword in text_input.lower() for keyword in keywords):

detected_emotion = emotion

break

self.emotion_history.append(detected_emotion)

return detected_emotion

def get_emotional_response_style(self, emotion):

"""Personalizar resposta com base na emoção detectada"""

styles = {

"happy": "Responda com entusiasmo e positividade!",

"sad": "Responda com empatia e apoio. Ofereça ajuda.",

"excited": "Combine com a empolgação deles! Use uma linguagem energética.",

"confused": "Seja paciente e explicativo. Desmonte ideias complexas.",

"neutral": "Responda de forma natural e prestativa."

}

return styles.get(emotion, styles["neutral"])

Passo 4: Executando o Agente

requirements.txt

genai-processors>=0.1.0 google-generativeai>=0.3.0 pyaudio>=0.2.11 opencv-python>=4.5.0 asyncio>=3.4.3

Comandos para executar o agente:

pip install -r requirements.txt python main.py

Vantagens dos GenAI Processors

- Experiência de Desenvolvimento Simplificada: GenAI Processors elimina as complexidades decorrentes do gerenciamento de várias chamadas de API e operações assíncronas. Os desenvolvedores podem focar diretamente na construção de funcionalidades em vez do código de infraestrutura.

- Interface Multimodal Unificada: A biblioteca oferece uma interface única e consistente para interação com texto, áudio, vídeo e dados de imagem.

- Desempenho em Tempo Real: Nativamente construído com asyncio do Python, os GenAI Processors se destacam ao lidar com operações simultâneas e dados de streaming.

- Arquitetura Modular e Reutilizável: Sendo modular, os componentes são muito mais fáceis de testar, depurar e manter.

Limitações dos GenAI Processors

- Dependência do Ecossistema Google: Embora suporte diferentes modelos de IA, ele é muito otimizado para os serviços de IA do Google.

- Curva de Aprendizado para Fluxos de Trabalho Complexos: Os conceitos básicos são diretos, mas aplicativos multimodais sofisticados exigem conhecimento de padrões de programação assíncrona e processamento de fluxo.

- Comunidade e Documentação Limitadas: Como um projeto relativamente novo, os recursos comunitários e tutoriais ainda estão evoluindo.

- Intensivo em Recursos: Requerimento computacionalmente caro em processamento multimodal em tempo real.

Casos de Uso dos GenAI Processors

- Bots de Atendimento ao Cliente Interativos: Construir agentes de serviço ao cliente que possam processar chamadas de voz, analisar emoções e dar respostas contextuais.

- Educadores: Tutores de IA: Projetar assistentes de aprendizagem personalizados que vejam expressões faciais e processem perguntas faladas.

- Monitoramento de Saúde ou Médico: Monitorar sinais vitais dos pacientes e integrar com bancos de dados médicos.

- Criação de Conteúdo e Produção de Mídia: Construir edição de vídeo em tempo real e geração automatizada de conteúdo.

Conclusão

Os GenAI Processors significam uma mudança de paradigma no desenvolvimento de aplicativos de IA. Através de uma interface comum, os desenvolvedores podem inovar em funcionalidades em vez de lidar com complicações.

Se você deseja construir o próximo grande bot de atendimento ao cliente ou assistente educacional, GenAI Processors é sua base para o sucesso.